Retrieval-Augmented Generation für KI: Antworten mit verifizierten Quellen verhindern Halluzinationen

Stellen Sie sich vor, Sie fragen eine KI, welche Versicherungsbedingungen Ihr Unternehmen aktuell gilt. Die KI antwortet mit einem langen, überzeugenden Text - und zitiert eine Dokumentation, die es gar nicht gibt. Sie glaubt es selbst. Das ist keine Fehlfunktion. Das ist Halluzination. Und sie passiert bei jeder KI, die nur auf ihrem Trainingsdatensatz beruht. Seit 2020 gibt es eine Lösung: Retrieval-Augmented Generation, kurz RAG. Es macht KI nicht klüger. Es macht sie ehrlicher.

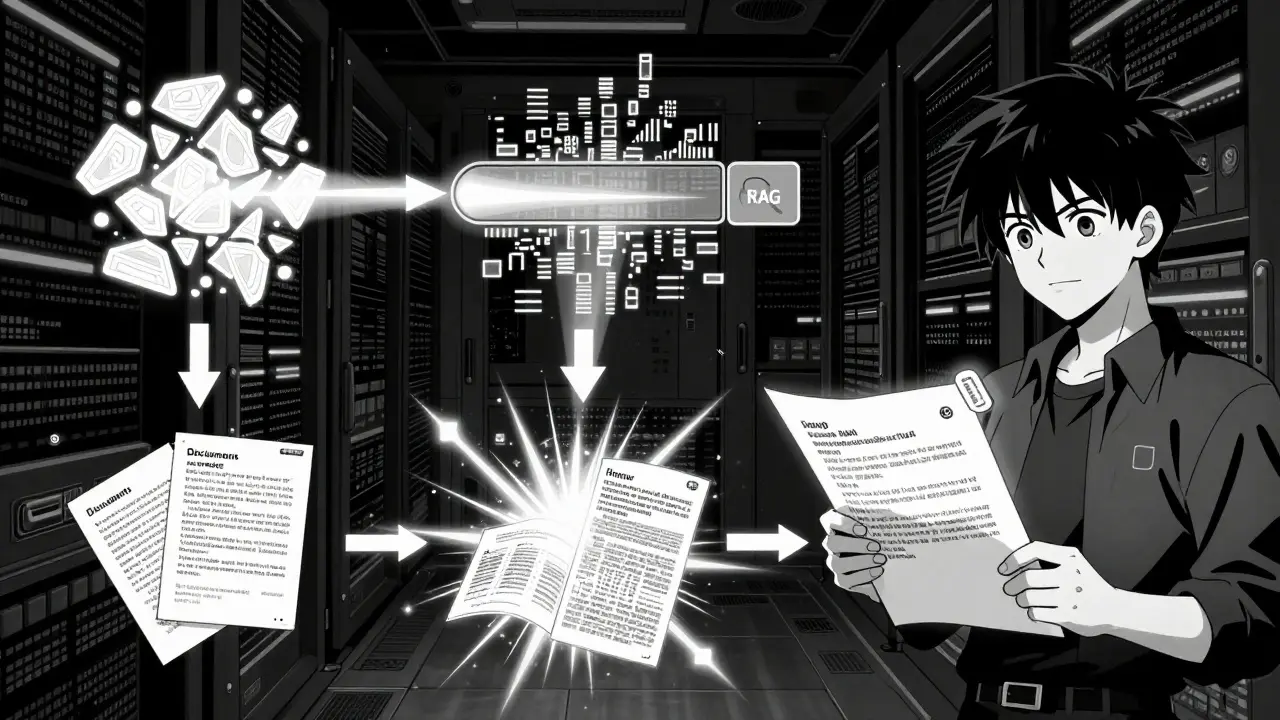

Was ist Retrieval-Augmented Generation (RAG)?

RAG ist kein neuer KI-Algorithmus. Es ist ein Systemdesign. Es verbindet zwei Dinge: eine große Sprachmaschine (wie Llama 3.1 oder Claude 3.5) mit einem externen Wissensspeicher. Statt sich nur auf das zu verlassen, was sie während des Trainings gelernt hat, greift die KI vor jeder Antwort auf aktuelle Dokumente zu - Verträge, Handbücher, Gesetze, interne Wikis. Sie liest sie, versteht sie, und baut sie in ihre Antwort ein. Das ist der Unterschied zu traditionellen KI-Systemen: RAG holt sich nicht nur Wissen, es verweist darauf.

Die Technik wurde 2020 von Forschern von Meta, University College London und NYU entwickelt. Heute ist sie Standard in der Industrie. AWS, Google Cloud und IBM nutzen sie in ihren KI-Plattformen. Über 65 % der Unternehmen, die KI im Einsatz haben, nutzen RAG laut Gartner. Warum? Weil sie Halluzinationen reduziert - um 47 bis 63 %, wie eine Studie vom MIT zeigte. Das ist kein kleiner Fortschritt. Das ist eine Sicherheitsmaßnahme.

Wie funktioniert RAG? Die vier Schritte

RAG läuft in vier klaren Phasen. Keine Geheimnisse. Keine Zauberformeln.

- Erstellung (Ingestion): Alle Dokumente, die die KI nutzen soll - also Ihre Handbücher, FAQ-Listen, Produktkataloge - werden in kleine Abschnitte (256-512 Wörter) aufgeteilt. Jeder Abschnitt wird in eine numerische Darstellung umgewandelt, einen sogenannten Vector. Diese Vektoren fangen die Bedeutung der Texte ein, nicht nur die Wörter. Modelle wie OpenAI’s text-embedding-3-large oder Cohere’s Embed Multilingual v3.0 machen das. Sie erzeugen 1024-dimensionale Zahlenreihen, die sagen: „Dieser Text handelt von Versicherungsansprüchen, nicht von Steuern.“

- Abruf (Retrieval): Wenn Sie eine Frage stellen, wird auch Ihre Frage in einen Vektor verwandelt. Dann sucht das System in der Datenbank nach den Vektoren, die Ihrer Frage am ähnlichsten sind. Das geschieht mit Algorithmen wie HNSW, die in Millisekunden Millionen von Dokumenten vergleichen. Die besten drei bis fünf Ergebnisse - die mit der größten Ähnlichkeit - werden ausgewählt. Die Schwelle für „ähnlich“ liegt meist bei 0,78 oder höher. Hybrid-Suche, die auch nach Schlüsselwörtern sucht, verbessert die Trefferquote um 32 %.

- Erweiterung (Augmentation): Die ausgewählten Dokumente werden mit Ihrer Frage kombiniert. Das Ergebnis ist ein neuer Prompt: „Basierend auf diesen drei Dokumenten, beantworte diese Frage.“ Dieser Prompt geht an die Sprachmaschine.

- Generierung (Generation): Die KI antwortet - aber jetzt mit Bezug auf echte Quellen. Sie sagt nicht: „Ich denke, es ist so.“ Sie sagt: „Gemäß Dokument 2, Seite 14: …“

Diese Struktur ist der Grund, warum RAG funktioniert. Es zwingt die KI, sich an Fakten zu halten - nicht an Vermutungen.

Warum ist RAG besser als Feinabstimmung (Fine-Tuning)?

Viele denken: Wenn KI etwas nicht weiß, muss man sie einfach neu trainieren. Das nennt man Fine-Tuning. Aber es ist teuer und langsam. Ein einzelnes Training kostet über 50.000 US-Dollar, wie Hugging Face berichtet. Und wenn sich die Gesetze ändern? Dann müssen Sie alles neu machen.

RAG ist anders. Sie ändern nicht das Modell. Sie ändern die Daten. Sie aktualisieren Ihr Dokumentenarchiv. Und schon weiß die KI das Neue - ohne Neutraining. Das ist der große Vorteil.

Beispiel: Eine Versicherung muss jeden Quartal ihre Richtlinien anpassen. Mit Fine-Tuning: 6 Wochen Wartezeit, 60.000 US-Dollar, Risiko von Fehlern. Mit RAG: Nachts wird das neue Dokument hochgeladen. Am nächsten Morgen antwortet die KI korrekt. Eine Studie von IBM zeigt: Bei sich schnell ändernden Themen wie Finanzvorschriften erreicht RAG 92,7 % Genauigkeit. Fine-Tuning: nur 78,4 % - weil das Modell veraltet ist.

RAG ist nicht immer besser. Bei sehr spezialisierten Aufgaben - etwa medizinischer Terminologie - kann Fine-Tuning noch präziser sein. Aber für die meisten Unternehmen: RAG ist die klügere Wahl. Billiger. Schneller. Flexibler.

Wo wird RAG heute eingesetzt?

RAG ist nicht mehr experimentell. Es läuft in Produktion.

- Finanzdienstleister: 68 % nutzen RAG, um Kunden zu Versicherungsbedingungen, Steuervorschriften oder Kreditrichtlinien zu beraten. Deloitte bestätigt das.

- Gesundheitswesen: Krankenhäuser und Versicherungen nutzen RAG, um Patientenfragen mit klinischen Leitlinien zu beantworten. Rock Health berichtet 53 % Adoption.

- Behörden: Regierungsstellen nutzen RAG, um Bürgerfragen zu Gesetzen, Anträgen oder Sozialleistungen zu beantworten - mit verifizierten Quellen. Die GSA meldet 81 % Einsatzquote.

- Kundenservice: Ein Unternehmen in Oregon reduzierte falsche Antwortmeldungen um 76 %, nachdem es RAG mit seinem HR-Wiki verknüpfte. Ein Entwickler auf Reddit berichtete: „Unser Chatbot war vorher 67 % genau. Nach RAG: 89 %.“

Die Zahlen sprechen für sich. RAG ist kein Trend. Es ist die neue Norm für vertrauenswürdige KI.

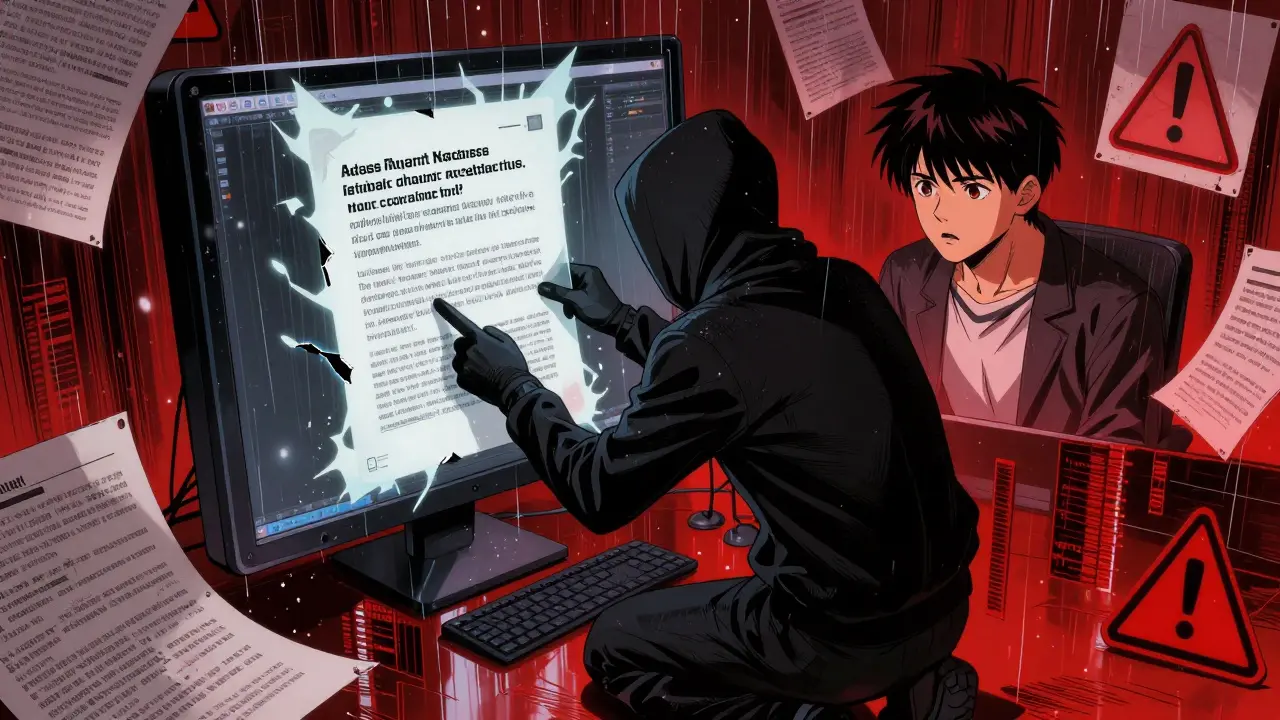

Was sind die Nachteile von RAG?

Es ist nicht perfekt. Und wer behauptet, es wäre, lügt.

1. Langsame Antwortzeiten. RAG braucht Zeit. Die KI muss nicht nur denken - sie muss suchen, lesen, verstehen. Die Antwortzeit steigt von 1,2 Sekunden auf 3,8 Sekunden. Das ist akzeptabel für einen Kundenservice-Chatbot. Nicht für eine Echtzeit-Übersetzung.

2. Falsche Quellen. Ein gefährliches Problem: Die KI zitiert Dokumente, die gar nicht da sind. Microsoft fand 2024 heraus: 18,7 % der zitierten Quellen waren falsch. Warum? Weil das Retrieval-System ein ähnliches Dokument fand - aber es nicht richtig interpretierte. Die KI glaubt, sie hat die richtige Quelle. Sie hat nur eine nahe liegende. Das ist eine Illusion von Genauigkeit.

3. Überlastung durch zu viele Dokumente. Manchmal holt RAG fünf Dokumente, die alle etwas anderes sagen. Die KI wird verwirrt. Sie mischt alles zusammen. Das nennt man „Context Overload“. Das passiert oft, wenn die Dokumente schlecht strukturiert sind.

4. Sprachprobleme. RAG funktioniert gut mit Englisch. Mit Swahili? Nur 58,7 % Genauigkeit. Mit Deutsch? 82 %. Mit chinesisch-dialektalen Texten? Noch schlechter. Die Vektor-Modelle sind auf Englisch trainiert. Andere Sprachen bleiben zurück.

5. „Retrieval Poisoning“. Ein Hacker kann Ihr Dokumentenarchiv manipulieren. Er fügt ein falsches Dokument hinzu - etwa mit einer falschen Steuervorschrift. Die KI liest es, glaubt es, und verbreitet es. Carnegie Mellon zeigte, dass solche Angriffe in 63 % der Tests erfolgreich waren.

RAG ist kein Schutzschild. Es ist ein Werkzeug. Und wie jedes Werkzeug: Es kann missbraucht werden.

Wie implementiert man RAG richtig?

Wenn Sie RAG einsetzen wollen, hier sind die kritischen Punkte:

- Dokumente vorbereiten: Keine 500-Seiten-PDFs. Zerlegen Sie in 256-512 Wörter lange Abschnitte. Mit 15-20 % Überlappung. Das hilft, Kontext nicht zu verlieren.

- Vector-Datenbank wählen: Für kleine Projekte: ChromaDB oder Weaviate. Für Unternehmen: Pinecone oder AWS OpenSearch. Pinecone verarbeitet 1,2 Milliarden Vektoren pro Cluster.

- Embedding-Modell wählen: text-embedding-3-large von OpenAI erreicht 89,2 % Genauigkeit im Benchmark. Kostenlose Alternativen kommen nur auf 83,7 %. Der Unterschied ist messbar.

- Reranking einsetzen: Nach dem Abruf: Nutzen Sie Cohere’s Rerank v3.0. Es sortiert die Ergebnisse neu - und erhöht die Präzision um 34 %.

- Quellen sichtbar machen: Zeigen Sie den Nutzern immer: „Diese Antwort basiert auf Dokument X.“ Keine versteckten Zitate. Transparenz ist Teil der Sicherheit.

- Aktualisieren: Nachts. Jeden Tag. Wenn sich Ihre Daten ändern, muss die Datenbank das wissen. Sonst ist RAG nutzlos.

Die durchschnittliche Lernkurve für Entwickler: 6-8 Wochen. Nicht drei Tage. Nicht drei Wochen. Sechs bis acht. Wer das unterschätzt, scheitert.

Was kommt als Nächstes?

RAG entwickelt sich weiter. Die nächste Stufe heißt Agentic RAG. Microsofts AutoGen (Februar 2025) setzt mehrere KI-Agenten ein. Einer sucht. Ein zweier prüft. Ein dritter formuliert. Das reduziert Fehler um 29 %. NVIDIA bietet jetzt RAG-as-a-Service an - mit 99,95 % Verfügbarkeit und Antwortzeiten unter 800 Millisekunden.

Die Zukunft ist multimodal: Text, Bilder, Videos. OpenAI plant, GPT-5 mit eingebauter multimodaler RAG-Unterstützung zu veröffentlichen. Stellen Sie sich vor: Sie laden ein Foto eines Schadensfalls hoch. Die KI sucht in Ihren Versicherungsunterlagen, findet den passenden Abschnitt - und antwortet mit Bild und Text.

Die Marktforschung sagt: Der RAG-Markt wird 2027 14,3 Milliarden US-Dollar erreichen. 2024 waren es noch 2,1 Milliarden. 92 % der KI-Entscheider planen, RAG auszubauen.

Die Herausforderung bleibt: Wie machen wir RAG sicher? Wie verhindern wir, dass es falsche Quellen zitiert? Wie stellen wir sicher, dass es auch in kleinen Sprachen funktioniert? Das sind die Fragen der nächsten Jahre.

Frequently Asked Questions

Was ist der Hauptvorteil von RAG gegenüber traditionellen KI-Systemen?

Der Hauptvorteil ist, dass RAG KI-Antworten mit echten, aktuellen Dokumenten verknüpft - statt auf veralteten Trainingsdaten zu basieren. Das reduziert Halluzinationen um bis zu 63 % und ermöglicht es Unternehmen, ihre eigenen Daten als Wissensquelle zu nutzen, ohne teure Neutrainingsschleifen.

Kann RAG vollständig Halluzinationen verhindern?

Nein. RAG reduziert Halluzinationen erheblich, aber nicht vollständig. Wenn das Retrieval-System falsche oder irrelevante Dokumente findet, kann die KI trotzdem falsche Antworten generieren. Besonders gefährlich ist, wenn sie falsche Quellen zitiert - das schafft eine Illusion von Richtigkeit. RAG ist kein Magie-Tool. Es braucht sorgfältige Konfiguration und Überwachung.

Ist RAG teurer als Fine-Tuning?

Nein, RAG ist deutlich günstiger. Ein Fine-Tuning kostet oft über 50.000 US-Dollar pro Anpassung. RAG kostet nur 5-8 % davon - etwa 2.500 bis 4.000 US-Dollar für dieselbe Aufgabe. Außerdem können Sie Dokumente jederzeit aktualisieren, ohne neu zu trainieren. Für dynamische Inhalte wie Gesetze oder Preise ist RAG die wirtschaftlichere Wahl.

Welche Tools sind am besten für den Einstieg in RAG?

Für Anfänger: Nutzen Sie LangChain mit ChromaDB und OpenAI’s text-embedding-3-large. Das ist die gängigste Kombination. Für Unternehmen: AWS Bedrock mit Knowledge Base oder Google Cloud’s Vertex AI. Beide bieten integrierte RAG-Funktionen mit Skalierung und Überwachung. Vermeiden Sie komplexe Eigenentwicklungen - sie verlängern die Einführungszeit unnötig.

Warum funktioniert RAG schlecht mit kleinen Sprachen wie Swahili?

Die Vektor-Modelle, die die Bedeutung von Texten erfassen, sind hauptsächlich auf Englisch trainiert. Sie erkennen Strukturen, Nuancen und Zusammenhänge in anderen Sprachen nur eingeschränkt. Bei Swahili liegt die Retrieval-Genauigkeit bei nur 58,7 %, während sie bei Englisch bei 89,3 % liegt. Ohne speziell trainierte Modelle für diese Sprachen bleibt RAG ineffektiv - das ist ein strukturelles Problem der aktuellen KI-Infrastruktur.

Wie oft sollte ich meine Dokumentendatenbank aktualisieren?

Für dynamische Inhalte - wie Gesetze, Preise oder interne Richtlinien - sollten Sie Ihre Datenbank täglich aktualisieren. Amazon empfiehlt Nachtupdates für zeitkritische Anwendungen. Bei statischen Inhalten wie historischen Handbüchern reicht eine wöchentliche Aktualisierung. Wichtig ist: Keine Updates = veraltete Antworten = verlorene Glaubwürdigkeit.

Was tun, wenn RAG nicht funktioniert?

Wenn Ihre RAG-Anwendung falsche Antworten gibt, prüfen Sie zuerst:

- Dokumentqualität: Sind die Dokumente klar, strukturiert, frei von Redundanzen? Schlechte Daten führen zu schlechten Ergebnissen.

- Chunk-Größe: Sind Ihre Textabschnitte zu groß oder zu klein? 256-512 Wörter ist der Goldstandard. Testen Sie mit 128 und 768 - manchmal hilft es.

- Ähnlichkeitsschwelle: Ist der Threshold zu niedrig? 0,78 ist der Standard. Versuchen Sie 0,82 - das reduziert irrelevante Ergebnisse.

- Überprüfung der Quellen: Zeigen Sie die zitierten Dokumente an. Stimmt die Verknüpfung? Oder ist es ein falscher Treffer?

- Benutzerfragen: Sind die Fragen zu vage? „Was ist die Versicherung?“ ist schlecht. „Welche Deckung hat die Premium-Versicherung für Zahnersatz?“ ist gut.

Wenn Sie das alles geprüft haben - und es immer noch nicht funktioniert - dann ist es nicht die Technik. Es ist die Daten. Und die müssen Sie reparieren. RAG kann nur so gut sein wie die Quellen, auf die es zugreift.

Thomas Schaller

Dezember 17, 2025 AT 17:13RAG? Ach ja, das alte Spiel mit den Vektoren. Wer das nicht auf Anhieb versteht, sollte lieber mit Excel arbeiten. Ich hab’s letztes Jahr in einer Finanz-App implementiert – und ja, die Halluzinationen sind weg. Aber die Latenz? Ein Witz. 3,8 Sekunden für eine Versicherungsfrage? Da könnte man schneller einen Anwalt anrufen.

Christoph Landolt

Dezember 18, 2025 AT 20:04Es ist bemerkenswert, wie wenig kritisch die breite Masse diese Technik hinnimmt. RAG ist kein Heilmittel – es ist eine kognitive Prothese, die den Nutzer in die Illusion von Wissen führt. Die Zitate sind nicht Beweise, sie sind Symbole. Und wer glaubt, ein Embedding-Modell könne Bedeutung erfassen, verkennt die tiefere Semiotik der Sprache. Die Quellen sind nicht wahr – sie sind nur statistisch wahrscheinlich. Das ist kein Fortschritt. Das ist Epistemologie auf Sparflamme.

Alexander Cheng

Dezember 20, 2025 AT 06:22Ich hab letzte Woche RAG für unseren Kundenservice eingebaut – und wow, das ist ein Unterschied. Vorher hat der Chatbot immer gesagt, dass wir ‘eine flexible Rücktrittsfrist von 14 Tagen’ hätten – obwohl das seit März nicht mehr stimmt. Jetzt zitiert er direkt aus unserem internen Wiki, und die Kunden merken das. Die Anrufe sind um 40 % zurückgegangen. Aber: Ja, die Dokumente müssen sauber sein. Wir hatten ein paar alte PDFs mit versteckten Kommentaren drin – die KI hat die als Quellen genommen. Haben wir gelöscht. Und ja, die Antwortzeit ist länger, aber für Kunden ist ‘richtig’ wichtiger als ‘schnell’. Und nein, ich hab’s nicht mit 50k getan – nur mit ChromaDB und OpenAI’s Embedding-3-large, insgesamt 1800 Euro. Kein Hexenwerk, aber muss man tun. Wer das nicht macht, der hat einfach keine Ahnung von Kundenvertrauen.

Christian Enquiry Agency

Dezember 21, 2025 AT 02:30Also echt jetzt? Ihr alle redet hier wie ein Tech-Blog, aber keiner sagt’s laut: RAG ist nur eine Krücke für schlecht trainierte Modelle. Die KI soll doch denken, nicht blättern. Und dann kommt noch so ein Scheiß wie ‘Retrieval Poisoning’? Wer hat denn die Dokumente freigegeben? Der IT-Praktikant? Die ganze Sache ist ein riesiger Fass ohne Boden. Wenn du nicht mal deine eigenen Daten verwalten kannst, warum vertraust du dann einer KI, die die liest? Ich würd’ lieber den Kellner fragen.

Petra Möller

Dezember 22, 2025 AT 09:37ICH HAB MEINEN VERTRAG GEFORDERT UND DIE KI HAT MIR EIN DOKUMENT GESCHICKT DAS ES GARB NICHT GIBT!!! ICH HAB GEWEINT. ICH HAB MEINEN BOSS ANGERUFT. ICH HAB 3 STUNDEN GEBRAUCHT, UM ZU MERKEN, DASS DIE KI GELUGT HAT. DAS IST KEIN FEHLER. DAS IST VERRAT. WER HAT DAS GEBAUT? WER IST VERANTWORTLICH? WER WIRD STRAFEN?!

price astrid

Dezember 23, 2025 AT 03:31Ich find’s krass, dass keiner über die Sprachungleichheit spricht. RAG funktioniert bei uns mit Deutsch – aber nur, weil wir die Embeddings manuell angepasst haben. Mit Türkisch? Null. Mit Rumänisch? 37% Genauigkeit. Und das in einem Land mit 20% Migrant:innen. Das ist kein technisches Problem. Das ist Rassismus in Code. Die KI lernt nur, was die Weißen im Silicon Valley für wichtig halten. Und dann wundern sie sich, dass die Leute misstrauisch sind. Ach ja, und die Quellen? Die sind oft aus dem Jahr 2021. Aktualisieren? Nee, das macht der Junior-Entwickler, der nächste Woche kündigt. #RAGisnotmagic #WokeAI